ELIZA効果を知る

ChatGPTに神を感じてしまうと思っていたが、思うべきは神の前に人であった。ChatGPTの回答の不完全さを考えれば、神もどきではなく人もどきとの印象が先行すべきだ。これについては、ELIZA効果(Eliza Effect)という言葉があるようだ。

ELIZAとは、いわゆる人工無能であって、簡単なアルゴリズムにより回答を返したプログラムだが、それがまさに今のChatGPTに驚きを感じるような体で受け止められたことについて、Eliza効果と言われているとのことだ。意識的にはわかっていても、無意識的にコンピュータの動作が人間と似ていると仮定する傾向を指す。

ポイントンとなるのは、「意識的には人間でないとわかっていること」「人間似ていると仮定すること」

後者だけであれば、それは単純な擬人化であり、まさにチューリングテストそのものの状況である。前者が加わることにより、特色が出ている。

ところで、Wikipediaを見ていると、「ELIZA効果は、擬人観よりも論理誤謬の程度は少ない。」とあった。これはどういうことか。そもそも擬人観という言葉が耳慣れないが「擬人観(ぎじんかん)とは人間以外の動植物、無生物、事物、自然、概念、神仏などに対し人間と同様の姿形、性質を見いだすことである。(Wikipedia)」とのこと。それよりも論理的誤謬の程度は少ないということは、一般的な擬人観の対象物においては、かならずしも人間と同様の姿形性質を見出すことはおかしくはないということだろうか。

なお、英語版Wikipediaには、「anthropomorphisation」のこととされていた。日本語版Wikipediaでは、「anthropomorphisation」は「人間形態観」と訳され、「personification」はより広い意味であり「擬人観」と訳されるが、ともに「擬人観」とも訳されるとのこと。ざっくり言えば、Eliza効果は、擬人観のひとつの特殊事例ということだ。

古の信仰と擬人観

擬人観とELIZA効果の違いで思い出したのだが、古の神や超自然的現象の人格化について、それは純粋にそういう人格を持つものだと思っていたのではないかと思うことがある。それは擬人化ではなく、まさに人だったのではないか。それらは、そこに在ったのではないかと。これを信仰という言葉で表わすのは、ずれがあると思っている。私が、他者に心があるように、他者に人格があると考えているように、それらの対象に対しても思っていたのではないか。

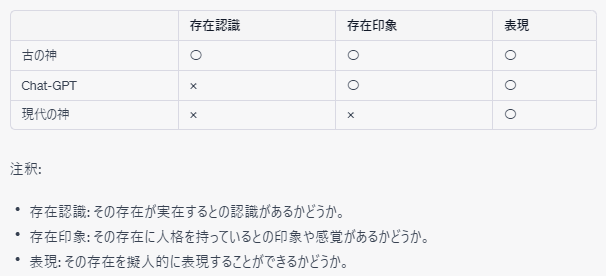

そこでいう擬人観とELIZA効果の違いについていえば、その対象たる存在が人格を持っているとの印象を持つことには変わりはないが、その存在が人格を持つ形で存在していると考えているか否かの違いがある(それが論理的誤謬の程度の違いか)。そして、それらについて、あたかも人格ある者の言動のように表現する。ざっくりまとめると次の表になる。

もちろん現代の神について考え方(考え方ということ自体がおこがましいかもしれない)に多様性はある。それはさておき、ChatGPTがこのように古の神と現代の神の中間的存在である印象を受けている。なお、ここでいう神はいわゆるGODではなく、日本的なそれである。

ChatGPTに対して開発を制限すべきとのOpen Letteerはあったが(署名者が開発を続けていたとの話もあるが)、この制限がもし倫理的なものであるとすると、この神的な者に対する許容度に由来することは考えらえるかもしれない。

一神教的GODが念頭に置かれれば、その劣化版のようなChatGPTは気味の悪いもの、許されないものとの分類がされやすいのではない。他方で、得体のしれないものもとりあえず受け入れやすい多神教やアニミズム的な感覚からすれば、それはそれとして存在するものであり、それ以上でもそれ以下でもないとなりやすそうだ。

新たなものに対して、この感覚が強みになったりしないだろうか。

1件のコメント